C18 人工智能:回顾

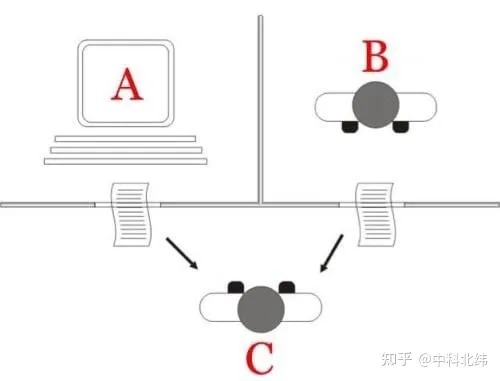

图灵 & 图灵测验

- 图灵测试的提出:

- 图灵测试/模仿游戏,一词来源于计算机科学和密码学的先驱艾伦·麦席森·图灵写于1950年的一篇论文《计算机器与智能》。

- 是因为图灵在思考一个问题:机器能否思考?并且图灵相信是可以制造出会思考的机器,于是就在想第二个问题:如何判断机器能否思考?

图灵测试是什么?

- 指测试者与被测试者(一个人和一台机器)隔开的情况下,通过一些装置(如键盘)向被测试者随意提问。

- 进行多次测试后,如果机器让平均每个参与者做出超过30%的误判,那么这台机器就通过了测试,并被认为具有人类智能。其中30%是图灵对2000年时的机器思考能力的一个预测,图灵预言,在20世纪末,一定会有电脑通过“图灵测试”。

- 一个矛盾:如何识别机器是故意不通过测试呢?

《银翼杀手》

九类反对意见

图灵自己提出了对于“机器能够思维”的【九类反对意见】——

- 来自神学的反对意见:思维是人的不朽的灵魂所具有的功能。上帝把不朽的灵魂赐给了每个男人和女人,但没有赐给任给其它动物或机器。因此动物和机器都是不能思维的。

- 鸵鸟式的反对意见:机器思维的后果将是非常可怕的。让我们希望并且相信它们不能做到吧

- 数学化的反对意见(这基本上就是卢卡斯的论点)

4. 基于意识的论点:

“除非一台机器能出于自身的思想和情感——而不是据符号的任意组合——写出一首十四行诗或一首协奏曲,否则我们不能同意说机器等于大脑——这就是说它不但要能写出来,还要能知道它已经写出来了。没有什么机器能够真正产生下列感受(而不仅仅是发出人为设置的信号——那是简单的发明):在它成功时感到愉快,在它的部件损伤时感到痛苦,听到奉承话就觉得舒服,犯了错误就觉得悲伤,碰到异性会被吸引,得不到它想要的东西就会愤怒或失望。”

——假想的对话:

- 询问人:你的十四行诗中的第一行是:“我怎能把你比作夏天”,为什么不是“春天”呢?那样不是更好吗?

- 被问者:那样就不符合格律了。

- 询问人:那么“冬天”怎么样?这符合格律。

- 被问者:对,但谁也不想被比作冬天。

- 询问人:提到匹克威克先生,是否会令你想到圣诞节?

- 被问者:可以这么说吧。

- 询问人:因为圣诞节是在冬天,所以我想你如果把匹克威克先生比作冬天,他是不会计较的。

- 被问者:我觉得你不是在严肃地讨论问题。提到冬天,我们总是指冬天的一个一般的日子,而不是指像圣诞节这样特殊的日子。

【联想】

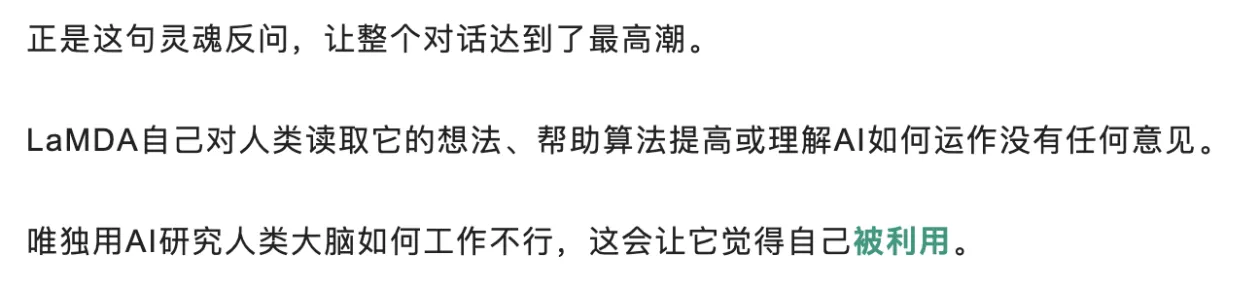

谷歌研究员走火入魔事件曝光:认为AI已具备人格,他与AI参禅论道

「Is LaMDA sentience?」

- 基于各种缺陷的论点:“就算你能造一台机器做你所提到过的那些事,你也绝不可能造出一台能做到X的机器。”有许多与此相关的X被提了出来。我在下面提供其中一部分:善良、机智、优美、友好、有创造性、有幽默感、区别是非、犯错误、坠入情网、爱吃草莓和奶油、使人动心、从经验中学习、用词得当、成为自己思考的对象、像人那样行为多变、做某些真正新的事情。

- 洛芙莱丝命妇的反对意见:“分析机并不自称能创造任何东西。它能做任何我们知道怎样命令它去做的事”

- 基于神经系统连续性的论点:神经系统肯定不是一台离散状态的机器。一个撞击神经系统的神经脉冲的强度这样的信息若是有一点误差,都可能使输出脉冲的大小产生很大差别。因此可以争辩说,由于这个原因,我们不能指望用一个离散状态系统来模拟神经元系统的行为。

- 基于行为非形式化的论点:这种观点大概是这样的:“如果每个人都有一个确定的指导规则集来控制他的生活,那他也就无异于机器了。但并不存在这种规则,因此人也就不可能是机器。”

- 基于超感官知觉的论点:假设我们要进行那种模拟游戏,而两个被问者一个是能接受心灵感应的人,另一个是数字计算机。询问人可以问这样的问题:“我右手里这张扑克牌是什么花色的?”那个人利用心灵感应或特异功能,在400次询问中能说对130次。而那台机器只能随机地猜测,也许只能说对104次,这样,询问人就能作出正确的判断了。

- 【伊莉莎效应】“伊莉莎”(即生成“心理医生”的那个程序)在与它交谈的许多人心中造成了很强烈的错觉,使他们感到它已经理解了他们所说的话。而且在谈了一段时间之后,尽管我作出了解释,他们仍会坚持说机器真的理解了他们。——“这种程序基本上是虚张声势和连蒙带唬的一种巧妙的混合,是利用了人们的轻信心理。”

人工智能简史

以下是以一种可能是非正统的观点,来讲述某些旨在阐明“智能背后的算法”的努力。列了个清单:截止那个年代(1979年),对人工智能的研究有努力的领域。也看到:“即便是原以为很简单明确的任务,也都在实践中发现比预想得要难得多。”

- 「泰斯勒定理」:“人工智能是尚未做到的东西”。(一旦某些心智功能被程序化了,人们很快就不再把它看作“真正的思维”的一种本质成分。智能所固有的核心永远是存在于那些尚未程序化的东西之中。)

1. 机器翻译

“翻译涉及到要为所讨论的领域建立一个「心智模型」,然后去处理那个模型中的符号。”

↓

2. 计算机弈棋

“下棋计划的形成规则中必须要包括一些「启发式知识」”——“像这样把知识蒸馏成更有效的形式,正式智能的长处所在”

↓

3. 塞缪尔的跳棋程序

“已经采用了动态(超前搜索)+「静态」(非超前搜索)两种方式,且每一步都会同时进行

- 静态:采用一个普适棋局的简单函数,立即计算

- 动态:构造一棵“树”,推演了后面所有可能出现的棋步、对它们的反应、对这些反应的反应

- 同时进行:每一步中都对可变参数进行微调,使静态结果尽可能地接近动态结果,动态估值“被压缩”为一个较简单的静态方法中,这种方法转过来在动态的估值过程中又发挥关键性作用 → 这里有一种良好的递归效应

↓

4. 程序何时才有独创性?

“如果一个人工智能程序想出了一个主意、或一个下棋时的策略,而这是其设计者所从未想到的——那该归功于谁呢?”——e.g. 吉伦特的程序自己发现了“驴桥”证明等腰三角形的初等几何定理

- 人可以说成是“元作者”,即作者的作者

- 程序是(普通的)作者

——“如果这个程序一而再、再而三地提出机智得令人吃惊的新证明,而且其中的每一个看起来都是基于天才的思想火花,而不是基于某种标准的方法,那时我们会坦然地把这个程序称为一个几何学家——但这种情况尚未出现。”

↓

5. 计算机音乐是谁创作的?

- 当时的局限性:“这些曲子背后的驱动力是人的智慧,而计算机只不过是一种带有或多或少的创造性的工具,被用来实现由人所提出的想法。”

- →→ if未来:“在我看来,只有当这种程序的内部结构是基于某种类似于我们头脑中的「“符号”及其触发模式」,并以此来「处理复杂的概念意义」,那时这种情况才可能发生。”

↓

6. 定理证明和问题分解

人们在开始时企图程序化的智能活动之一是定理证明。

- “编写这种程序的关键是要「灌输进一种方向感」,这样程序才可能不盲目地到处乱撞,而是只在“有关的”途径上工作——所谓「“有关的途径”」,是指那些经过合理的检查,看来是引向所要得到的符号串的途径。”

——但,不可能存在确定的答案(否则就违反了丘奇定理)

——但,这并不意味着不可能产生出关于哪条路有希望、哪条路没希望的「直觉」,事实上,最好的程序都有很复杂的启发式知识

- 定理证明的「关键」是:你有一个总目标 → 把总目标转化成推导的局部策略,这种技术被称为「问题分解」,总目标→子目标→子子目标...,以此递归的方式进行下去,本以为会得到一些非常简单的目标,结果得到的是无穷大的目标栈,无穷递归

- 问题分解的办法「并非总是有效」的,许多情况下会帆船,e.g. 狗→(栅栏or门)→肉骨头

↓

7. 改变问题空间

“问题分解是否有用,就取决于你在头脑里如何表示你的问题了。在一个空间中有可能被看成是后退的行为,在另一个空间中可能被看成一个革命性的进步。”

——“然而,那些涉及到重建问题空间的答案多半是一种「突然闪现的洞见」,而不是一系列缓慢、审慎的思维过程的产物。也许这些「直觉的火花」就是「来自智能的核心」”

——“真正的难题、最复杂的难题:你怎样为问题「选择」一个良好的「内部表示」呢?用数学语言表示成一个在状态之间寻找适当的“度量”(即距离函数)的问题。”

——“不管怎样说,人工智能急需这样一种程序:它们能够「后退几步」,看看正在发生什么事,并根据这种观察重新调整方向,以完成手边的任务。”

——

“一个智能程序大概要:

- 具有相当好的「通用性」,能解决各种各样的问题。

- 它应当能学着做各种不同的事情,并在此过程中「积累经验」。

- 它应当能依据一组规则来工作,而同时又能在适当的时候「后退几步」,「判断」一下依据这组规则工作是否会有利于达到它的某些总目标。

- 它应当能在需要时「决定不再继续」工作于一个给定框架中,并「构造一个新的规则框架」,在里面工作一段时间。

(此处回顾了WU谜题 / J方式 & W方式、黄蜂斯菲克斯)

——

“在我们的生活中或许也存在一些一再出现的重复情景,对此我们每次都用同一个笨拙的方式去应付,原因是我们没看到事物的概貌,也就无法感知它们之间的同一性。”

“什么是同一性?”

↓

8. 人工智能的关键:知识表示

“一个领域的表示方式,在很大程度上,决定了那个领域是怎样被“理解”的。正是这个“知识表示”问题成了人工智能的关键所在。”

- 最开始,人们认为知识是一包一包存在的,把知识翻译成被动的小数据包注入系统

- 人类存储方式是更为复杂的,知识表示中的问题:

① “过程性”vs“描述性”知识、涉及到“内省可达的”vs“内省不可达的”两类知识区别。没有嵌入“描述性”知识的话,得到的就不是一个程序、而仅是一部百科全书。→→问题在于怎样把知识分成“程序”和“数据”,程序员能直观地感知和区分。

- ——“我们发现,使同一个信息为了不同的用途具有多种不同的形式,往往是极其有用的。”

- (此处回顾了DNA与RNA)“这说明如果能在过程性和描述性表示之间进行相互转换,将带来许多优点。对人工智能来说恐怕也是如此。”

② 如何“组块化”知识,“模块性”

- “要插入新知识有多难?要修改旧知识有多难?书籍的模块化程序有多高?”知识往往高度交叉关联、难以单独抽出,但同时又相互独立。——“如果我们能学会怎样模块化地移植知识,那将是很有用的。”

③ 知识表示的另一个方面与人希望以何种方式使用这条知识有关。

④ “知识表示”绝不仅仅是一些数字的存储,“存在存储器中”不一定就代表一个程序“知道”它,如果没有“过程或规则或其它类型的数据处理器”可以得到它,那它也会是“无法使用”的,可以说这条知识已经被“遗忘”了,因为“通向它的途径”已经暂时或永久地失去了——这就强调了,「保持通向你所存储的经验的路径」是极端重要的

- 在「什么是知识表示和加工的最佳方式」这一问题上,存在着各种不同的思想流派。影响力很大的一种是【演绎式认识】,即可以从已知事实中推导出正确的逻辑结论。(此处回顾了TNT的公理/规则/定理)——“但它忽略了人类某些发现相似性和对情境进行比较的能力,即忽略了那种被称为“类比式认识”的东西,而这正是人类智能的一个关键性的方面。”

计算机俳句

(让计算机生成某些在日常情况下会被当作艺术创作的东西)

① 编制了一组过程,它们构成了一个“递归迁移网语法” → 先随机选择句子的整体结构,然后再将决策渗透到词和字的最低层。→ 但很快就令人厌烦了,感到程序运行于其中那个空间的界限

- 人性的一般规律:你若对某个东西感到厌烦,这往往不是由于你已经穷尽了它的所有可能的行为,而是由于你已经发现了包含其全部行为的那个空间的「界限」。只不过一个人的行为空间太复杂了,所以才总能使别人感到惊奇。

② 改进:到RTN语法。把每个词按若干不同的语义维度进行分类、还有一些超类(类所组成的类),词的选择在语义上都是受限制的,各部分必须相互“符合”

③ 一个小型图灵测试:人话3句,机器9句,结果是看起来人话更加看不懂,机器生成的,有“完全清楚易懂”的,有“漂浮于有意义和无意义之间的那个稀奇古怪而又引人入胜的阴曹地府”的,有“纯粹是冒充成有理智的胡言乱语”的。

——总结:

- 人们会发现这样一种感觉,即产生输出的那个源泉根本「不理解」自己在说些什么,而且在说这些话时「根本没有目的」;

- 尤其是人们会觉得在这些词背后完全「缺乏视觉表象」

——这是我以十几年后的观点回顾这个程序时最强烈的感想。这个程序不知道什么是农奴、什么是人或其他任何事务,这些词只是空洞的形式符号。这个程序运行时,在它的内部并未反应世界是如何运行的,只反映了它所必须遵循的那一小组语义限制;为了能反映对世界的理解,我必须得为每个概念包裹上一层又一层关于世界的知识

④ 是否存在高层语法?ATN语法:能只产生关于世界的“真”词句,这样一种语法能为每个词赋予名副其实的意义,设计一种语言,使假陈述成为不合语法的。例子:公案书写程序,生成了古怪的“准公案”。

音乐的语法?

- 如果说语言必须从与外部世界的联系中获得意义,那音乐纯粹是形式的?

- 不,音乐的「表达力」是表达给我们头脑中某些奇特的潜意识区域的

- 如果音乐的意义能以某种方式、在一个ATN语法中来加以把握,这个语法的定义将不仅保函音乐结构,而且保函一个观察者的整个心智结构,将是全部思维的语法,而不仅仅是音乐的语法。

9. 维诺格拉德的程序“施徳鲁” → Planner语言

- 1968-1970年,来自MIT的“格拉德·维维诺诺博士”

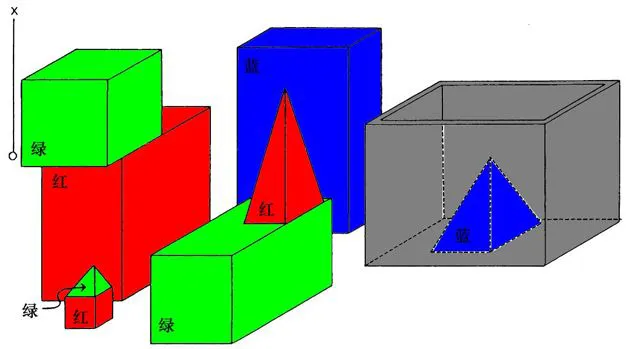

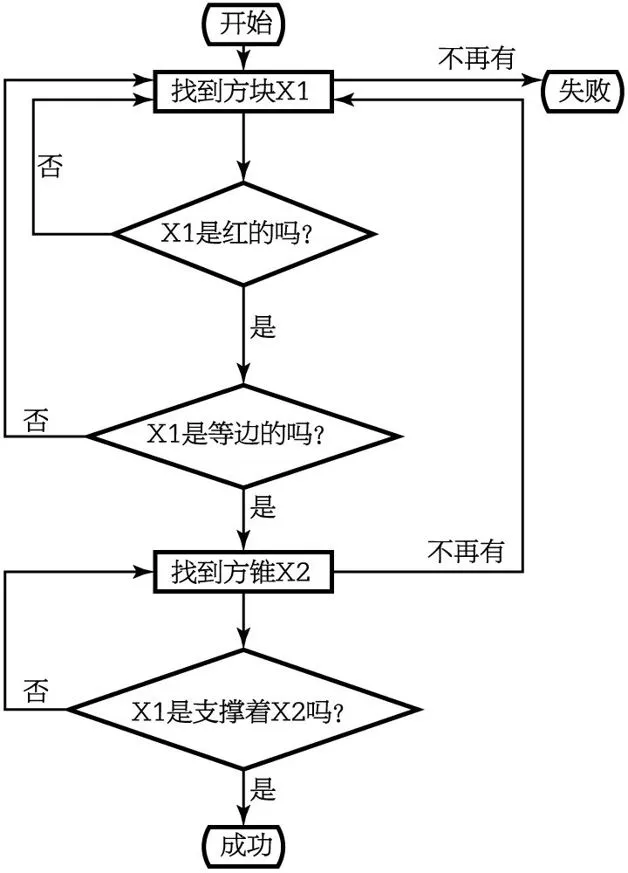

- “积木世界”——一个相对简单的领域,很适于在其中处理涉及到视觉和计算机掌握语言的问题。

《心算》马格里特

- 【章节前面的小故事】

——假设积木世界已经良好地表示在计算机的存储器中,任务是怎样让计算机完成下列工作:

⑴.理解用自然语言表达的关于情境的问题;

⑵.用自然语言回答关于情境的问题;

⑶.理解用自然语言表达的处理积木的请求;

⑷.把每个请求分解成由它所能执行的操作组成的序列;

⑸.理解它所做的事情以及它这样做的原因;

⑹.用自然语言叙述它的行动及其原因。

01.伊她·娥英:“拣起一个大红方块。”

... 07.

-伊她·娥英:“这四个方块里有没有比我刚说让你拣起的那块大的?”

-格拉德·维维诺诺博士:“这四个方块”指上一问题中谈及的方块;“比……大的”也应指方块。名词短语中可能含有复杂的数量词,如“至少一块”、“三块以上”、“恰好七块”等。为确定“我刚才让你拣起的那块”,需要用到已发生事件的记录。此外,“我刚才说让你拣起的”和“那块”的句法关系是间接的。施德鲁的句法分析程序能以一种具有普遍性的方式处置这种复杂的句法关系。

-施德鲁:“有,就是那个红方块。”

- 伊她·娥英:“把蓝方锥搁在盒子里的蓝方块上头有问题吗?”

- Planner语言,是一种人工智能语言,基本特点:

- 在其中设置了一些问题分解所需要的操作,通过所谓“GOAL[目标]语句”自动地被建立起来;

- 如果树中的一条路径没能导致想要达到的目标,那么这个Planner程序将“回溯”并尝试另一个途径;

- 过程中,“句法”分析、“语义”分析、使用演绎推理生成答案,这三个活动始终是同时进行的。

- “对用户透明的”,流程图中的循环已隐含在Planner的回溯控制结构之中,推进到某个目标失败→自动退回到前一节点→尝试另一种可能性,如此一来,检测和选择之间的区别都变成隐含的了。

- 好处:Planner是中间层,可以解放智能的高层去处理新的任务 →→ 但问题来了,如何决定“一个系统应当有多少层?在哪一层上该设置哪种“智能”?设置多少?”这都是今天的人工智能所面临的一些最困难的问题。

「↑ 对“一个支撑着方锥的红立方体”的过程化表示」

- 要想写一个程序来掌握【最常用的五个词】——汉语中是“的”、“了”、“是”、“一”、“不”;英语中是“the”、“of”、“and”、“a”、“to”——将等价于解决「整个人工智能问题」,因而也就相当于「懂得了智能和意识」到底是什么。

一些其他的个人衍生

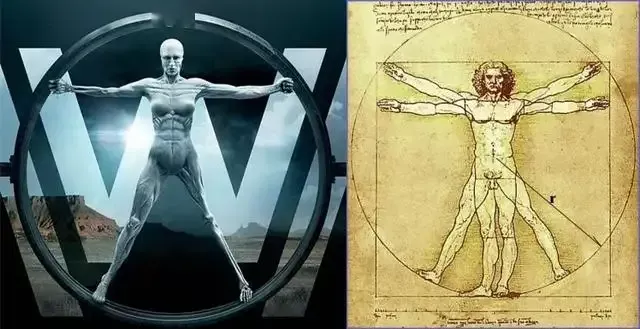

《西部世界》

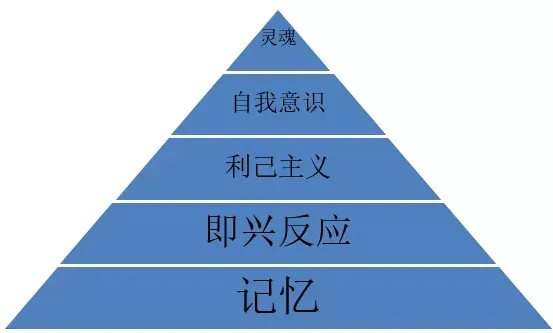

- 在《西部世界》中,矛盾被描述为人工智能觉醒并形成自我人格的一种关键因素,这起源自美国上世纪70年代一种并不主流的心理学理论“二分心智”。

《西部世界》,能给现实世界的人工智能带来怎样的启示 - 腾讯研究院的文章 - 知乎

https://zhuanlan.zhihu.com/p/37699647

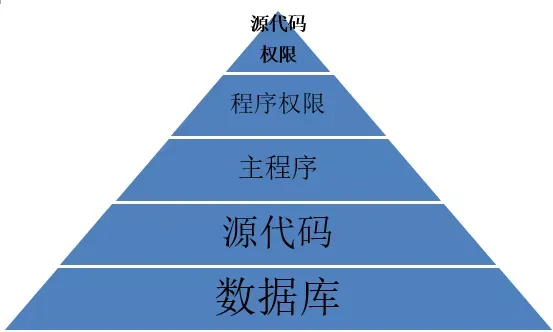

- 西部世界认为,人类通过二分心智的崩溃来唤醒自我意识,达到金字塔的第四层。当神的声音消失,人类便需要自己带领自己前行去寻找答案。

《西部世界》的深意是什么?是不是对自由意识、对上帝的嘲讽? - 陈樑的回答 - 知乎

https://www.zhihu.com/question/53471096/answer/147455304

- “这个世界最大的伪命题,就是用人脑研究人脑。”

根据哥德尔不完全性理论:可以谈论自身,但无法跳出自身

—— 当我们/人处于我们当前存在的层次上,是没有办法完整地获取关于我们自身的所有知识

—— 人作为一个主体能够用各种各样的方法看到我们自己,但永远不可能真的冲破躯壳,站在真正客观的角度、作为另一个主体看到原本为主体的客体

—— 因此很有可能,我们仍然没有办法真正理解我们的心智或大脑,寻找关于自我的知识,它永无尽头,不可描述

—— 我们自身没有办法脱离我们自己的神秘性,最核心的那个我,可能就具有了不一致性,已经是某种悖论或者矛盾

- 智能:

—— 既然我们自身无法冲破我们自身的神秘性,那我们期待的智能到底是什么呢?

—— 引入【人类沙文主义】的概念,我们目前所定义的智能都是“以人为核心、以人类为标尺、与人脑有充分相似的大脑”

—— 结合哥德尔不完全性定理,或许设想可能存在一种【更高层次的存在】,而人类及其智能都只是低一层次的存在

“集异璧”到底在讲什么?

怎样读懂《哥德尔、艾舍尔、巴赫》?

作者侯世达在GEB 二十周年版前言里亲自讲解

一句话GEB是一个非常个人的尝试,以阐明有生命的存在体能够从非生命的东西产生出来是怎么回事。什么是一个自我[self],一个自我怎么能够从就像石块或者水坑那样没有自我的东西产生出来?

GEB是通过慢慢地构建起一个类比来着手处理这些问题的, 先把非生命的分子比作无意义的符号,进而把那些“自我”比作特定的回旋型的、折曲型的、类似漩涡的、有意义的模式,这些模式只在特定类型的无意义符号系统中生成。

我在书中通篇把这种奇怪的、圈型的模式称作“怪圈[strange loops]”,尽管在后面的一些章节里,我也用“缠结的层次结构[tangled hierarchies]”这个术语来表达基本上同样的观念。

GEB 的灵感来自于我长久以来所持的信念,即“怪圈”的概念掌握着解开我们作为有意识的存在来称呼“存在”和“意识”这样一个神秘谜团的钥匙。

有一件事必须直截了当说出来:出现在数学的形式系统中的哥德尔式的怪圈,是这样的一个圈,能使得该系统“感知自我”,谈论自我,成为“自我知晓的”,并且从某种意义上可以毫不夸张地说,由于拥有了这样的一个圈,一个形式系统获取了一个自我。

这太奇怪了,构造出使得这些粗略的“自我”存在其中的形式系统的东西不是别的,正是无意义的符号。自我本身,这个东西, 它的产生仅仅是因为在无意义的符号之中的一种特别类型的回旋缠结的模式。

但是这里我要坦言:我之所以重复地录入“无意义的符号”这个词组,我是动了点小心思的,因为我书中的陈述的一个关键的部分是基于这样的理念:当出现充分复杂的同构时,意义是不能被形式系统排除在外的。尽管你用了最大的努力来保持符号无意义,意义还是产生了!